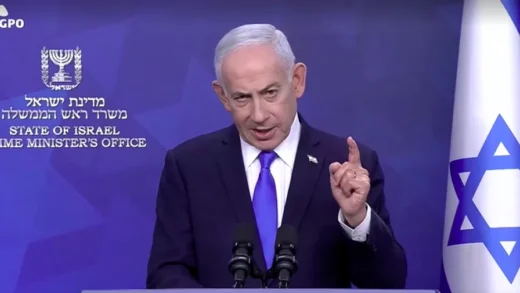

Ketegangan memuncak antara perusahaan teknologi kecerdasan buatan (AI) terkemuka, Anthropic, dan Departemen Pertahanan Amerika Serikat (AS), ketika CEO Anthropic, Dario Amodei, dengan tegas menyatakan perusahaannya tidak akan tunduk pada tuntutan Pentagon terkait penggunaan teknologi AI mereka. Konflik ini, yang berpusat pada potensi penggunaan AI Anthropic untuk pengawasan domestik massal dan senjata otonom penuh, menandai titik balik penting dalam perdebatan global tentang etika dan kontrol teknologi AI. Anthropic, salah satu pemain kunci dalam pengembangan AI generatif dengan model bahasanya Claude, memilih untuk berdiri teguh pada prinsip-prinsip etika mereka, bahkan jika itu berarti kehilangan kontrak militer yang menguntungkan dan menghadapi ancaman politik serius.

Perselisihan ini bermula ketika Menteri Pertahanan AS, Pete Hegseth, menuntut agar Anthropic menerima segala bentuk penggunaan yang sah atas teknologinya oleh militer AS. Tuntutan ini bertentangan langsung dengan filosofi inti Anthropic, yang sejak awal didirikan dengan komitmen kuat terhadap pengembangan AI yang aman dan bertanggung jawab. Pertemuan antara kedua belah pihak dilaporkan berakhir dengan ancaman eksplisit untuk mengeluarkan Anthropic dari rantai pasokan Pentagon, sebuah langkah yang dapat berdampak signifikan pada prospek bisnis perusahaan. Selain itu, insiden ini juga disebut-sebut telah membuat Presiden AS, Donald Trump, murka, menyoroti tingkat kepentingan strategis dan politik dari konflik tersebut.

Dario Amodei, yang dikenal sebagai salah satu pendiri dan pemimpin yang berprinsip di dunia AI, tidak gentar menghadapi tekanan ini. "Ancaman-ancaman ini tidak mengubah posisi kami, hati nurani kami tidak membenarkan untuk menuruti permintaan mereka," tegas Amodei, sebagaimana dikutip oleh detikINET dari BBC. Pernyataan ini bukan sekadar penolakan bisnis, melainkan penegasan komitmen moral dan etika yang mendalam terhadap arah pengembangan dan penerapan teknologi yang mereka ciptakan. Bagi Anthropic, beberapa kasus penggunaan AI mereka—khususnya Claude—untuk pengawasan domestik massal dan senjata otonom, adalah garis merah yang tidak bisa dilintasi. Amodei menekankan bahwa penggunaan semacam itu belum pernah dimasukkan dalam kontrak mereka dengan Departemen Perang (nama sekunder untuk Departemen Pertahanan) di masa lalu, dan tidak seharusnya dimasukkan sekarang.

Persoalan utama bagi Anthropic adalah dampak etis dan sosial yang bisa timbul dari penggunaan AI dalam skenario-skenario tersebut. Pengawasan domestik massal menggunakan AI menimbulkan kekhawatiran serius tentang privasi, kebebasan sipil, dan potensi penyalahgunaan kekuasaan. Algoritma AI yang mampu menganalisis data dalam skala besar dapat digunakan untuk melacak individu, memprediksi perilaku, atau bahkan menargetkan kelompok tertentu, yang bertentangan dengan nilai-nilai demokrasi dan hak asasi manusia. Di sisi lain, senjata otonom penuh, atau sering disebut "robot pembunuh", menghadirkan dilema etis yang jauh lebih kompleks. Kemampuan mesin untuk membuat keputusan hidup atau mati tanpa intervensi manusia menimbulkan pertanyaan tentang akuntabilitas, kemanusiaan, dan potensi eskalasi konflik yang tidak terkendali. Anthropic berpendapat bahwa teknologi AI saat ini, bahkan yang paling canggih sekalipun, belum cukup andal atau matang untuk dipercayakan dengan penilaian kritis yang diperlukan di medan perang, apalagi dalam konteks keputusan hidup dan mati.

Menanggapi ketegasan Anthropic, Departemen Pertahanan AS melalui Wakil Menteri Pertahanan Emil Michael, menyerang balik Amodei. "Pada tingkat tertentu, Anda harus memercayai militer Anda untuk melakukan hal yang benar," sebut Michael, mencoba menempatkan tanggung jawab kepercayaan pada pihak perusahaan. Michael juga menunjukkan bahwa penggunaan AI yang ditakuti Anthropic sebenarnya sudah dilarang oleh hukum dan kebijakan Pentagon. Namun, ketika ditanya mengapa Pentagon tidak menyetujui bahasa kontrak yang secara eksplisit diminta Anthropic untuk mencegah penggunaan tersebut, Michael menjawab, "Kita harus bersiap menghadapi apa yang sedang dilakukan China." Pernyataan ini mengungkap kekhawatiran Pentagon tentang perlombaan senjata AI global dan kebutuhan untuk mempertahankan keunggulan teknologi atas pesaing geopolitik, terutama Tiongkok, yang agresif dalam mengembangkan kemampuan AI militernya.

Ancaman Pentagon tidak hanya terbatas pada pencabutan kontrak. Pejabat Pentagon sebelumnya telah mengisyaratkan bahwa jika Anthropic tidak patuh, Hegseth akan memastikan Undang-Undang Produksi Pertahanan (Defense Production Act/DPA) diberlakukan. DPA adalah undang-undang federal yang memberi presiden AS wewenang untuk mewajibkan perusahaan atau produknya dianggap sangat penting sehingga pemerintah dapat memaksanya untuk memenuhi kebutuhan pertahanan nasional. Ini adalah alat yang sangat kuat, biasanya digunakan dalam keadaan darurat nasional, dan penerapannya terhadap perusahaan AI seperti Anthropic akan menjadi preseden yang signifikan dan berpotensi kontroversial. Namun, Amodei tetap pada pendiriannya, menyatakan kesediaan untuk bekerja sama dalam memastikan kelancaran transisi ke penyedia lain jika Departemen Pertahanan memilih untuk berhenti menggunakan Anthropic. Ini menunjukkan bahwa perusahaan tersebut memprioritaskan prinsip di atas keuntungan finansial jangka pendek.

Lebih lanjut, juru bicara Anthropic mengungkapkan bahwa meskipun perusahaan telah menerima draf kontrak yang diperbarui, draf tersebut "hampir tak menunjukkan kemajuan mencegah penggunaan Claude untuk pengawasan massal atau dalam senjata otonom penuh." Mereka mengklaim bahwa "bahasa baru yang dibingkai sebagai kompromi dipasangkan dengan bahasa hukum yang memungkinkan perlindungan tersebut diabaikan sesuka hati." Ini menyoroti kekhawatiran Anthropic terhadap potensi "celah hukum" yang memungkinkan Pentagon untuk pada akhirnya menggunakan teknologi mereka dengan cara yang tidak disetujui, meskipun ada klaim kompromi.

Amodei menjelaskan lebih lanjut posisi perusahaannya mengenai penggunaan AI dalam konteks militer. "Kami mendukung penggunaan AI untuk misi intelijen dan kontraintelijen asing yang sah. Namun menggunakan sistem ini untuk pengawasan domestik massal tidak sejalan dengan nilai-nilai demokrasi," ujarnya. Ini menunjukkan bahwa Anthropic tidak sepenuhnya menentang kerja sama dengan militer, tetapi memiliki batasan yang jelas berdasarkan nilai-nilai etika dan demokratis. Mengenai AI yang digunakan dalam persenjataan, Amodei menegaskan kembali bahwa sistem AI yang paling canggih dan mumpuni saat ini pun "sama sekali belum cukup andal untuk menggerakkan senjata otonom penuh." Ia menekankan pentingnya pengawasan manusia. "Kami takkan dengan sengaja menyediakan produk yang membahayakan para prajurit dan warga sipil Amerika. Tanpa pengawasan tepat, senjata otonom penuh tidak dapat diandalkan untuk menerapkan penilaian kritis yang ditunjukkan oleh pasukan profesional kita yang sangat terlatih setiap harinya. Senjata-senjata tersebut perlu dikerahkan dengan batasan keamanan layak, yang belum ada saat ini," paparnya.

Sikap tegas Anthropic ini mencerminkan perdebatan yang lebih luas dalam industri teknologi tentang tanggung jawab pengembang AI terhadap dampak sosial dan etika dari inovasi mereka. Banyak perusahaan AI, termasuk Anthropic yang mengembangkan "Constitutional AI" sebagai metodologi untuk mengarahkan perilaku AI agar selaras dengan prinsip-prinsip yang diinginkan, sedang bergulat dengan pertanyaan tentang bagaimana memastikan teknologi mereka digunakan untuk kebaikan dan tidak disalahgunakan. Konflik ini juga menjadi pengingat bahwa meskipun pemerintah berupaya memanfaatkan setiap keuntungan teknologi untuk kepentingan keamanan nasional, ada batasan-batasan etika yang tidak dapat diabaikan, terutama ketika teknologi tersebut memiliki potensi untuk secara fundamental mengubah masyarakat dan perang itu sendiri.

Pada akhirnya, perselisihan antara Anthropic dan Pentagon ini bukan hanya tentang satu kontrak atau satu perusahaan, melainkan tentang menetapkan preseden global untuk tata kelola AI. Ini adalah pertarungan antara imperatif teknologi dan batas-batas etika, antara kebutuhan keamanan nasional dan nilai-nilai demokrasi. Hasil dari konflik ini kemungkinan akan membentuk cara perusahaan AI berinteraksi dengan pemerintah di seluruh dunia, serta menentukan batasan moral dalam perlombaan senjata AI yang semakin intensif.